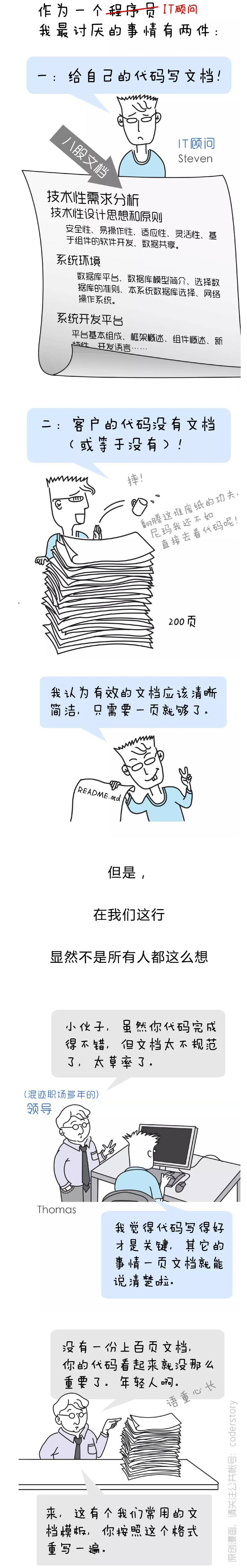

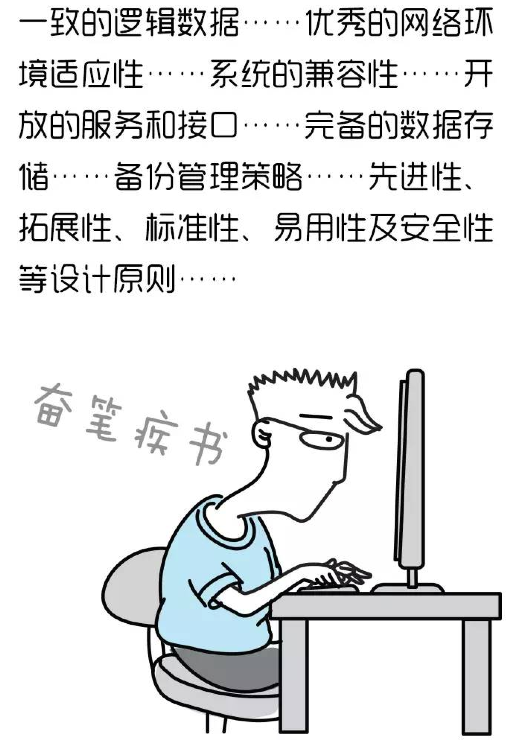

21 让你最痛苦的技术文档是如何制造出来的……

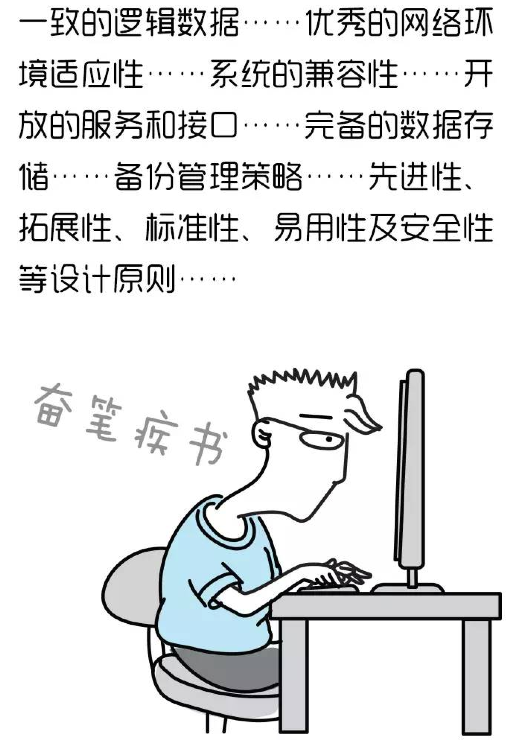

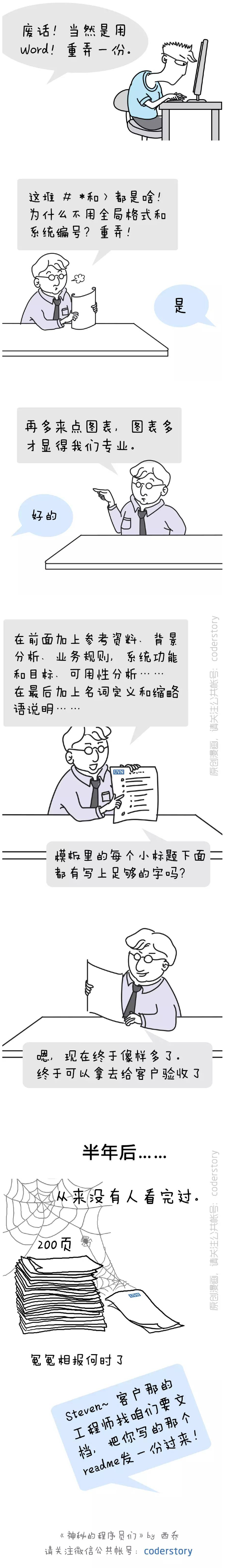

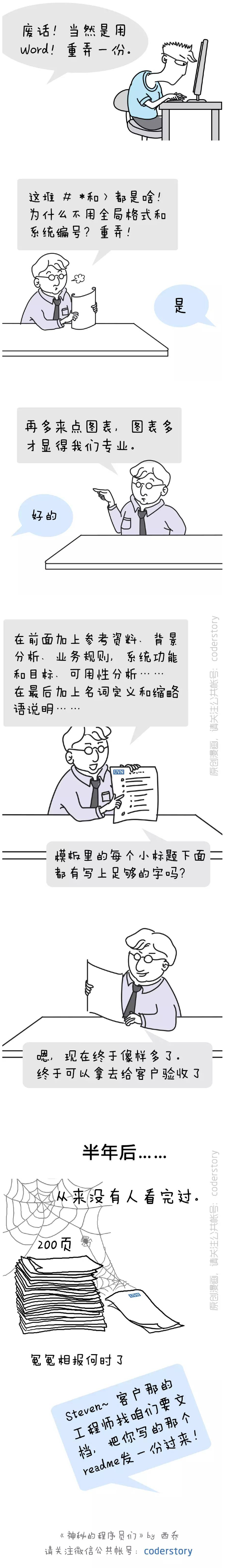

200 页文档? 冤冤相报何时了!

21 让你最痛苦的技术文档是如何制造出来的……

200 页文档? 冤冤相报何时了!

最近,我越来越感到不可思议:”这是怎么回事,我在 .net 中使用这个已经很多年了,我甚至不知道没有它生态系统是如何存在的。其他人对此有何看法?

我不希望这变成一场语言大战。我的问题是出于善意,而且我确实想从在这里发表评论的人们那里汲取智慧。使用 Rust 的时间比我长得多的人可以提供我可能不知道的宝贵见解。因此,为了避免 “火焰战争”,请允许我尽可能具体地说明这个问题:

除 Hadoop 生态系统外,我还在其他数据库和分析工具(如 MatLab)中看到一些对 MapReduce 的引用。在我的印象中,Spark 完全取代了 MapReduce。是否只是 MapReduce 的实现方式不同,而 Hadoop 实现的 MapReduce 被 Spark 取代了?

放屁。专业的文档是以后的基础,一看就没写过程序。成就一个系统前,几千封邮件,几百份文档都是必须要有的,否则开发出来也是废物。